[디지털경제뉴스 박시현 기자] 인텔은 첨단 반도체 기술 컨퍼런스 ‘핫 칩스 2024’에서 데이터센터, 클라우드, 네트워크에서 엣지 및 PC에 이르기까지 AI 활용사례 전반에 걸쳐 폭넓고 깊이 있는 기술을 선보였다.

이번에 공개된 기술은 인텔 제온 6 SoC(코드명 그래나이트 래피즈-D), 클라이언트 프로세서 루나 레이크, AI 가속기 인텔 가우디 3, 고속 AI 데이터 처리를 위한 완전 통합형 광학 컴퓨트 인터커넥트(OCI) 칩렛 등이다.

먼저 인텔 제온 6 SoC는 인텔 역사상 가장 엣지에 최적화된 프로세서가 될 것으로 보인다. 단일 시스템 아키텍처와 통합된 AI 가속 기능을 사용해 엣지 디바이스에서 엣지 노드까지 확장할 수 있어, 기업은 데이터 수집부터 추론에 이르기까지 전체 AI 워크플로우를 보다 쉽게, 효율적으로, 그리고 안전하게 관리할 수 있다.

인텔 제온 6 SoC는 인텔 제온 6 프로세서의 컴퓨트 칩렛과 인텔 4 공정 기술을 기반으로 설계된 엣지에 최적화된 I/O 칩렛을 결합했다. 이를 통해 SoC는 이전 모델에 비해 성능, 전력 효율 및 트랜지스터 집적도 면에서 상당한 개선을 이룰 수 있었다.

인텔 제온 6 SoC의 특징은 △최대 32레인의 PCI 익스프레스 5.0 △최대 16레인의 컴퓨트 익스프레스 링크 2.0 △BGA 패키지로 제공되는 4개 및 8개의 메모리 채널 △작동 온도 범위 확장 및 산업용 수준에 적합한 신뢰성을 포함한 엣지별 개선 사항 적용으로 고성능 러기드 장비에 최적화 등이다.

인텔 제온 6 SoC는 새로운 미디어 가속화 기술을 탑재해 실시간 OTT, VOD 및 방송용 비디오 트랜스코드 및 분석 등 엣지 및 네트워크 워크로드의 성능 및 효율을 개선하는 기능을 담고 있다.

또한 △추론 성능 향상을 위한 인텔 AVX(Advanced Vector Extensions) 및 인텔 AMX(Advanced Matrix Extensions) △보다 효율적인 네트워크 및 스토리지 성능을 위한 인텔 QAT(QuickAssist Technology) △vRAN의 전력소모 감축을 위한 인텔 vRAN 부스트 △사용자가 기본 하드웨어에서도 클라우드처럼 편리하게 AI 솔루션을 구축, 전개, 실행, 관리 및 엣지 스케일링할 수 있도록 하는 인텔 타이버 엣지 플랫폼 등을 제공한다.

차세대 AI PC용 루나 레이크는 이전 세대에 비해 시스템 온 칩 전력을 최대 40%까지 낮추면서 뛰어난 성능을 제공한다. 새로운 신경처리장치(NPU)는 최대 4배 더 빠른 속도를 보이며, 이전 세대 대비 생성형 AI 성능을 크게 향상시킨다. 또한, 새로운 Xe 2 GPU 코어도 게임 및 그래픽 성능을 이전 세대보다 1.5배 향상시킨다.

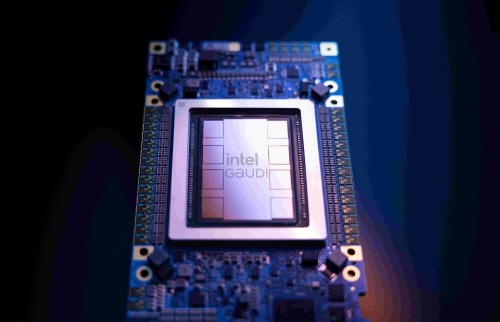

인텔 가우디 3는 효율적인 행렬 곱셈 엔진, 이중 캐시 통합, 광범위한 RoCE(RDMA over Converged Ethernet) 네트워킹 등 다양한 전략을 채택했다. 이를 통해 AI 데이터센터가 더욱 비용 효율적이고 지속 가능하게 운영될 수 있도록 성능과 전력 효율성을 크게 향상시켰다.

인텔은 이번 행사에서 완전 통합 광학 컴퓨트 인터커넥트(OCI) 칩렛을 인텔 CPU에 코-패키징해 실시간 데이터를 실행하는 최첨단 기술을 시연했다.

인텔의 OCI 칩렛은 최대 100m의 광섬유에서 각 방향으로 32Gbps 데이터 전송 64채널을 지원하도록 설계됐으며, 더 높은 대역폭, 더 낮은 전력 소비, 더 긴 도달 거리에 대한 AI 인프라의 수요를 충족시킨다.

인텔의 OCI 칩렛은 일관된 메모리 확장 및 리소스 분리를 포함한 새로운 컴퓨팅 아키텍처와 CPU/GPU 클러스터 연결의 향후 확장성을 지원하며, AI 인프라에서 코패키징된 광학 I/O을 지원한다.